Contenido

PalancaCadenas de Markov de tiempo continuo

En el caso del tiempo discreto, observamos los estados en momentos instantáneos e inmutables. En el marco de las cadenas de Markov en tiempo continuo, las observaciones son continuas, es decir sin interrupción temporal.

Tiempo continuo

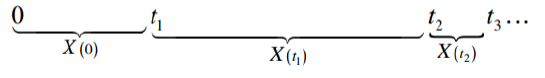

Sean M + 1 estados mutuamente excluyentes. El análisis comienza en el tiempo 0 y el tiempo corre continuamente, llamamos X (t) al estado del sistema en el tiempo t. Los puntos de cambio de estado tI son puntos aleatorios en el tiempo (no son necesariamente completos). Es imposible tener dos cambios de estado al mismo tiempo.

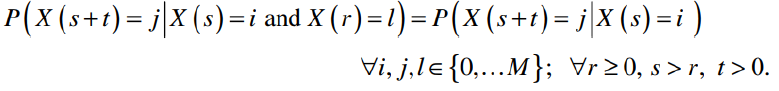

Considere tres puntos consecutivos en el tiempo donde ha habido un cambio de estados r en el pasado, s en el momento presente y s + t en el futuro. X (s) = i y X (r) = l. Un proceso estocástico de tiempo continuo con la propiedad de Markov si:

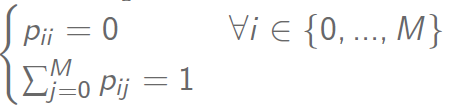

Las probabilidades de transición son estacionarias ya que son independientes de s. Denotamos por pij(t) = P (X (t) = j, X (0) = i) la función de probabilidad de transición en tiempo continuo.

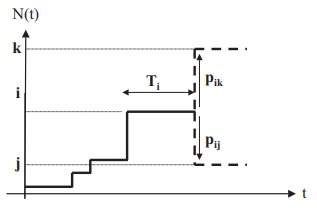

Denotar por TI una variable aleatoria que denota el tiempo pasado en el estado i antes de pasar a otro estado, i∈ {0,…, M}. Suponga que el proceso entra en el estado i en el tiempo t '= s. Luego, para una duración t> 0, TI > t ⇔ X (t '= i), ∀t'∈ [s, s + t].

La propiedad de estacionariedad de las probabilidades de transición da como resultado: P (TI > s + t, TI > s) = P (TI > t). La distribución del tiempo restante hasta la próxima salida de i por parte del proceso es la misma independientemente del tiempo que ya pasó en el estado i. La variable TI no tiene memoria. La única distribución de variable aleatoria continua que tiene esta propiedad es la distribución exponencial.

La distribución exponencial TI tiene un solo parámetro qI y su media (expectativa matemática) es R [TI ] = 1 / qI. Este resultado nos permite describir un cadena de markov en tiempo continuo de manera equivalente como sigue:

- La variable aleatoria TI tiene una distribución exponencial del parámetro λ

- cuando el proceso sale del estado i, pasa al estado j con una probabilidad pij como (similar a una cadena de Markov de tiempo discreto):

- el siguiente estado visitado después de i es independiente del tiempo pasado en el estado i.

- La cadena de Markov de tiempo continuo tiene las mismas propiedades de clase e irreductibilidad que las cadenas de tiempo discreto.

Estas son algunas propiedades de la ley exponencial:

Modelo de duración

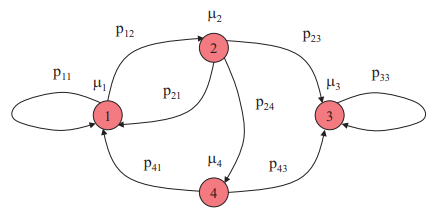

Por tanto, si consideramos μI el parámetro de la variable aleatoria exponencial asociada con el estado i, podemos representar la cadena de Markov en tiempo continuo de la siguiente manera:

Podemos ver claramente la cadena de Markov en tiempo discreto incluida, de ahí la posibilidad de realizar un estudio del modelo discreto. Tenga en cuenta que no existe una noción de periodicidad en este contexto.

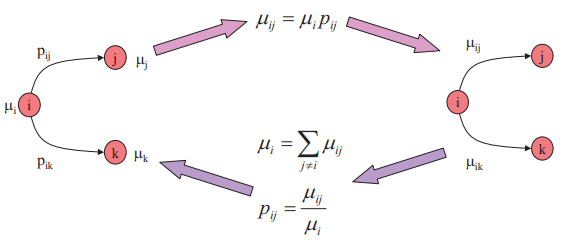

Si consideramos que pasamos del estado i al estado j después de un tiempo Tij y que consideramos este tiempo como una variable aleatoria exponencial de tasa μij, entonces es posible escribir la cadena de Markov en tiempo continuo bajo un modelo de duración:

Tenga cuidado, hay un gran cambio entre el lado estocástico del movimiento de un estado a otro y el lado continuo en el tiempo. Es importante comprender que la matriz de transición de una cadena de Markov en tiempo continuo es siempre un modelo de duración.

La matriz de transición de un modelo de duración tiene las siguientes propiedades:

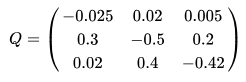

Esta matriz se llama generador infinitesimal.

Así, desde el grafico siguiendo la ecuación discreta de Markov (la ley exponencial es la misma en los tres estados):

Es posible obtener el siguiente modelo de tiempo: